1. U-Net: Convolutional Networks for Biomedical Image Segmentation (May, 2015, citation 38,000+)

https://arxiv.org/pdf/1505.04597

- Introduction

· Biomedical Image Segmentation의 전통적인 과제: Labeled 된 학습 데이터의 부족, Localization과 Context를 어떻게 잡아낼 것인지.

· Biomedical Image는 Labeling 비용이 커 많은 양의 Ground Truth(정답 데이터셋)를 모으기 어려움.

· U-Net은 Data Augmentation - Elastic deformation을 도입해, 소수의 GT 만으로도 학습시키도록 함.

Touching cells의 경계에서는 경계 픽셀에 Weighted loss를 설계하여, 맞닿은 객체를 벌려서 학습하도록 유도함.

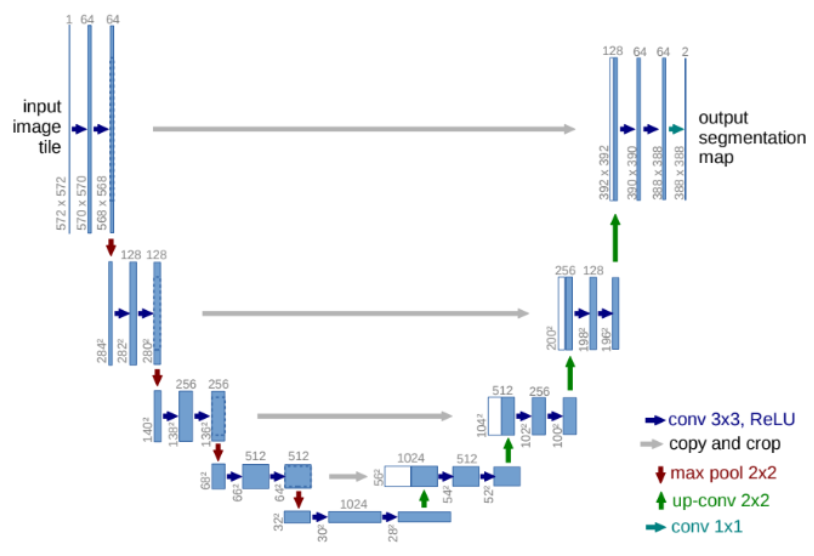

- Network Architecture

[전체 구조]

· U자 형태: Contracting path + Expanding path

- Contracting path: feature 추출, spatial resolution(공간해상도)를 낮추어(down sampling) image의 context 확보

- Expanding path: 낮아진 해상도를 다시 높여(up sampling), 픽셀 단위에 필요한 정밀 위치정보 복원

Skip connections: Contracting path의 고해상도 특징을 Expanding path에 복사하여 위치 정보 보존

[세부 층 구성]

Contracting path: (Conv(3x3) + ReLU) X 2 = 이미지 패턴 감지, 반복하여 복잡한 특징 학습

-> MaxPooling = 2x2 크기로 나눠 큰 값만 남김, context 파악

-> Channel 수 2배 증가 = 해상도는 줄이고, 채널은 늘림

Bottleneck(U자의 바닥부분): (Conv(3x3)+ReLU) X 2

-> Dropout = 추상적이고 개념적인 특징을 담음.

Expanding path:

| Up-Convolution (2×2 Transposed Conv) |

이미지 크기를 2배로 키움 | 해상도 복원 |

| Concatenate (Skip Connection) | 같은 단계의 인코더 출력을 복사해서 붙임 | 고해상도 위치 정보 보존 |

| Conv(3×3) + ReLU | 특징 결합 | 낮은 수준의 정보(위치)와 높은 수준의 정보(의미) 결합 |

| Conv(3×3) + ReLU | 반복 | 노이즈 제거, 세부 경계 복원 |

Outer layer: 1x1 convolution 수행, Softmax 또는 Sigmoid 함수 사용하여 각 픽셀의 클래스 확률로 변환

- Training

1) Dataset: 제한된 GT로 학습하였기 때문에, Data augmentation이 중요하였음.

2) Strategy: Elastic deformation, Random rotation/shift/flip, Gray value variation

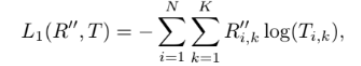

3) Loss function: Cross-Entropy를 기본으로 사용하나, touching cells에서 발생하는 문제는 Weighted loss를 사용함

4) Optimizer & Hyperparameter

5) Overlap-tile strategy(patch 단위로 GPU에 올림)/ Mirroring(경계에서 정보 손실 예방)

6) Test

- Experiments

1) ISBI EM Segmentation Challenge: ISBI 2012 EM Challenge Dataset

√ 뉴런의 EM image, GT: 세포 경계

√ 학습설정: 30개 정도의 슬라이스로 증강

√ 평가지표: Foreground IoU, Pixel-wise accuracy, Boundary precision

√ 결과: 기존의 Sliding-window CNN 보다 Touching Cells 분리 기능 개선, 경계 부근의 false merge/split 감소

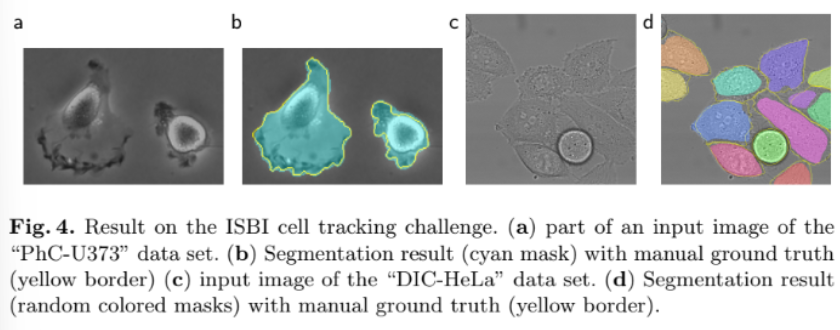

2) ISBI Cell Tracking Challenge: ISBI Cell Tracking Challenge 2015 Dataset

√ Phase contrast microscopy, Differential interference contrast 모달리티 사용하여 세포 프레임에서 segmentation

√ 약 20개의 이미지, 동일한 U-Net 구조, 동일한 Augmentation 전략 사용

√ 평가지표: Segmentation accuracy

√ 결과: 데이터 수가 적을수록 격차가 더 커짐 (데이터 효율성 극대화). Border line 따라 회색조 정확하게 분리 가

- Conclusion

다양한 Biomedical segmentation 과제에 대해 우수한 성능을 보였으며, Annotated image 수가 매우 적어도 end-to-end 학습이 가능하다.

2. A Deep Learning Approach for Brain Tumor Classfication and Segmentation Using a Multiscale Convolutional Neural Network (Feb, 2021)

https://pmc.ncbi.nlm.nih.gov/articles/PMC7912940

A Deep Learning Approach for Brain Tumor Classification and Segmentation Using a Multiscale Convolutional Neural Network - PMC

Abstract In this paper, we present a fully automatic brain tumor segmentation and classification model using a Deep Convolutional Neural Network that includes a multiscale approach. One of the differences of our proposal with respect to previous works is t

pmc.ncbi.nlm.nih.gov

- Introduction

뇌종양(Meningioma, Glioma, Pituitary tumor)은 높은 사망률, 재발률로 조기 진단 매우 중요

Single-scale 특징만 고려 / 전처리(background filtering) / Segmentation - Classification 별도 수행의 한계를 극복하기 위해

Multi-scale CNN & Brain tumor을 동시에 segmentation & classfication 하는 딥러닝 접근법 사용

- Materials and Methods

1) Dataset: 환자 233명의 MRI Image 3,064장 (T1c, axial/coronal/sagittal view)

2) Data Augmentation

3) Proposed multiscale CNN - Sliding window 방식으로 65x65 pixel 단위 patch 생성

· Three-Path CNN: large scale / medium scale / small scale 3개의 병렬 경로로 구성, 각 경로의 feature map을 concatenate하여 픽셀 단위로 종양 유형 예측

· Healthy tissue / Glioma / Meningioma / Pituitary tumor 중 하나로 분류

· Loss function: Cross-entropy loss 사용

4) 평가: Classfication accuracy, Sensitivity, Specificity, Dice Similarity Coefficient

- Results and Discussion

Accuracy = 0.973, Sensitivity = 0.975, Specificity = 0.980, Dice coefficient = 0.94

Global / Local 특징을 모두 포착하였고, Region boundary를 정확하게 탐지

But T1c 모달리티만 사용하였기 때문에, T2나 FLAIR 등의 추가 모달리티 확장 필요함

- Conclusion

Multiple CNN을 활용하여 Brain tumor segmentation / classfication 통합수행 모델을 제시

1) 전처리 과정 없이도 높은 정확도

2) multiple scale feature 학습을 통해 tumor의 형태적 다양성을 잘 포착

3) segmentation과 classfication을 하나의 구조로 통

3. ImageNet Classification with Deep Convolutional Neural Networks (2012, citation 38,000+)

https://papers.nips.cc/paper_files/paper/2012/hash/c399862d3b9d6b76c8436e924a68c45b-Abstract.html

ImageNet Classification with Deep Convolutional Neural Networks

Requests for name changes in the electronic proceedings will be accepted with no questions asked. However name changes may cause bibliographic tracking issues. Authors are asked to consider this carefully and discuss it with their co-authors prior to reque

papers.nips.cc

- Introduction

대규모의 Image classfication 문제에 Deep learning, 특히 Convolutional Neural Networks(CNN)을 적용

-> GPU 병렬 학습을 이용해 CNN 학습

-> ReLU 활성화 함수를 도입해 학습속도 향상

- Dataset

· ImageNet Large Scale Visual Recognition Challenge (ILSVRC) 2010의 1,000 classes

· 다양한 해상도와 비율, 복잡한 배경을 포함하였으며 객체 중심이 아닌 일반 사진으로 구성하였음

· 전처리 및 입력 방식: image의 짧은 변을 256px로 resize, extract randomly 224 x 224 px crop, normalization

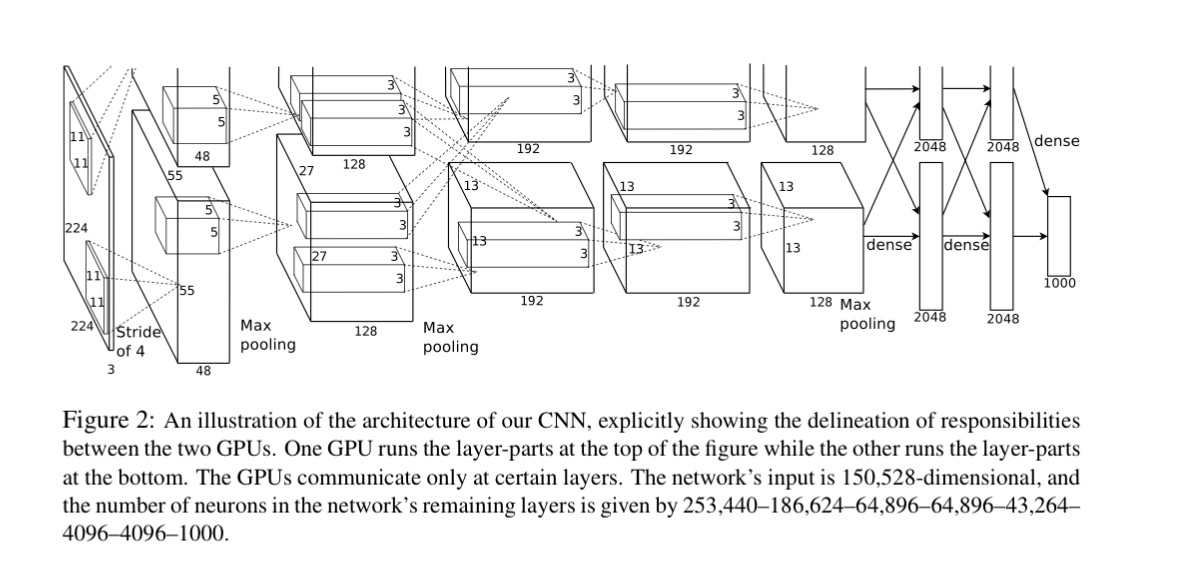

- Architecture = 5 Convolutional Layer + 3 Fully Connected layer

| 1 | Conv | 11×11, stride 4, 96 filters | 55×55×96 | ReLU + LRN + Pool |

| 2 | Conv | 5×5, stride 1, 256 filters | 27×27×256 | ReLU + LRN + Pool |

| 3 | Conv | 3×3, 384 filters | 13×13×384 | ReLU |

| 4 | Conv | 3×3, 384 filters | 13×13×384 | ReLU |

| 5 | Conv | 3×3, 256 filters | 13×13×256 | ReLU + Pool |

| 6 | FC | 4096 neurons | ReLU + Dropout | |

| 7 | FC | 4096 neurons | ReLU + Dropout | |

| 8 | FC | 1000 neurons | Softmax |

- Reducing overfitting

1) Data Augmentation -

- Geometric transformations: horizontal flip (학습이미지 수 가상 확대)

- Photometric transformations: 조명, 색상 변화에 강인한 특징 학습

2) Dropout

- Fully connected 층(6, 7 번째 층)에서 뉴런을 50 % 확률로 임시 제거

- 각 학습 step마다 다른 서브네트워크를 학습하는 효과

- 테스트 시에는 모든 뉴런을 사용하되 weight × 0.5로 스케일 조정

- Details of learning

•Optimizer: Stochastic Gradient Descent (SGD)

•Batch size: 128

•Momentum: 0.9

•Weight decay: 0.0005 (L2 regularization)

•Learning rate: 초기 0.01 → validation error 정체 시 × 0.1로 감소

•Weight initialization: 평균 0, 표준편차 0.01의 Gaussian

•Bias initialization: Conv2, Conv4, Conv5, FC6, FC7 → 1 (ReLU 초기 활성화 촉진)

•Training time: 2 GPU 병렬 학습으로 약 5 ~ 6일

- Results

• Early layers: edge, color blob, gradient 방향 등

• Middle layers: object parts

• Deep layers: class-specific patterns

[SOTA]

4. Causal Intervention for Brain Tumor Segmentation (MICCAI 2024, pp.160-170)

https://papers.miccai.org/miccai-2024/paper/2795_paper.pdf

- Introduction

· 의료 영상에서 Brain Tumor Segmentation은 임상진단과 치료계획 수립의 핵심적인 단계임.

· 기존 딥러닝 Segmentation model은 통계적 상관관계에 기반한 학습

→ Background(영상)와 Foreground(병변) 사이의 비의도적 상호작용인 Confounding effect 발생

→ Interference(서로 다른 병변 유형 간 간섭), Domain bias(데이터 편향) 등의 문제가 있음

· 본 논문에서는 Causal inference의 개념을 의료영상의 Segmentation에 도입하여 Causal relationship에 초점을 둠.

· 핵심목표: 병변의 실제 특징을 학습하도록 하여, 배경 노이즈 및 주변 조직의 영향 최소화

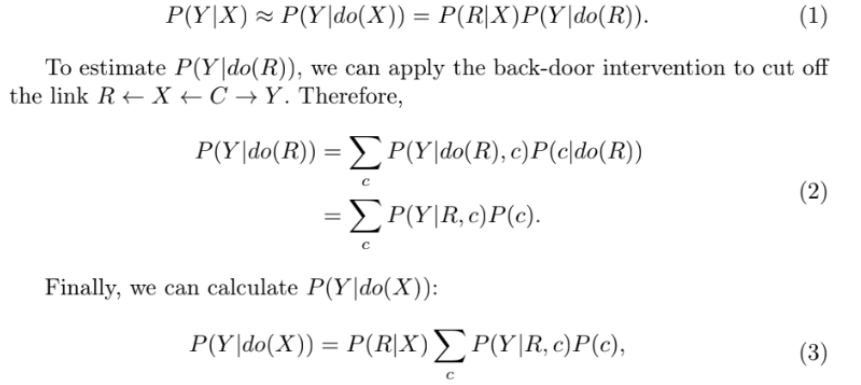

- Method: Causal inference를 Segmentation network(U-Net 계열)로

Causal Graph

(1) 입력된 MRI 영상을 U-net encoder로 받아 feature map 구성

(2) Region Causality Module이 Rough segmentation map 형성 (병변의 대략적 영역 예측)

(3) Feature map에 곱해서 Confounder(배경 잡음/불필요한 정보 제거) 새로운 feature R' 형성

(4) Category Causality module에 (2)번 R, (3)번 R' 넣어 Interference 줄임

-> Enhancing tumor/edema/necrosis 처럼 비슷한 부위들이 헷갈리지 않도록 조정

(5) Decoder에서 정제된 feature R'을 업샘플링하여 해상도 복원, 최종 Segmentation mask 출

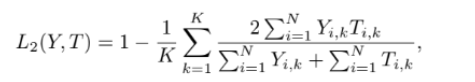

*Region causality module

*Category causality module

- Experiments

(1) Dataset: BraTS(Brain Tumor Segmentation Challenge) 2020 / 2021 dataset

T1, T1c, T2, FLAIR 포함 369개+125 환자 영상, 병변 레이블 포함

*T1(fat 조직 밝게, water 어둡게 -> 전반적 뇌 구조 관찰)

*T1c(T1 촬영 전 조영제 주입 -> 종양, 염증 부위 확인)

*T2(water 밝게, fat 어둡게 -> 부종, 염증, 낭종 확인)

*FLAIR(fluid 어둡게 -> 뇌실 근처 병변, 부종, 허혈 확인)

(2) 비교모델: U-Net, Attention U-Net, nnU-Net, TransUNet

(3) 평가지표: DSC(Dice Similarity Coefficient), Sensitivity, Specificity, Hausdorff Distance(경계 오차)

(4) 결과: DSC - U-Net보다 3.7%, nnU-Net보다 2.4% 높음, 경계가 흐릿한 종양과 multiclass tumor에서 안정

- Conclusion

본 연구는 medical image segmentation 문제를 causal interpretation으로 접근하여 lesion과 background의 관계를 명확히 학습 -> 데이터 편향이 있는 환경에서도 좋은 성능을 보임

5. A Foundation Model for Brain Lesion Segmentation with Mixture of Modality Experts (MICCAI 2024)

https://papers.miccai.org/miccai-2024/paper/0143_paper.pdf

- Introduction

Brain lesion segmentation은 Lesion과 Modalities(T1,T2,FLAIR,DWI 등)에 따라 데이터 분포가 달라 생기는 문제

-> 각 병변마다 별도의 모델 필요, 여러 모달리티가 존재하거나 누락되는 경우 예측 결과 일정하지 X

*DWI: 확산 정도 측정(병변으로 인해 세포 밀도 변화하는 경우 확산 패턴 변동)

따라서, 다양한 병변과 모달리티를 하나의 foundation model로 통합하고 각 모달리티에 서브모델(Expert) 조

- Methods

[전체구조: Mixture of Modality Experts: MoME]

· 입력 MRI 데이터 Modality별로 Experts 네트워크를 두어 개별적인 특징을 추출한 후 출력값을 Gating network가 결합하여 최종 Segmentation mask 생성

1) Hierarchical Gating

- 다단계 게이팅 구조 -> multi-scale 특징 결합

- Expert E1(Modality M1), Expert E2(Modality M2)... 형식

- Ex) FLAIR 영상은 T2영상과 유사하게 보이지만, Fluid 신호가 억제되어 있음.

두 modality의 서로 다른 특징을 통해 Expert가 collaboration 하게 됨.

2) Curriculum Learning Strategy

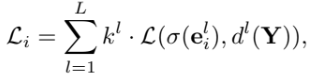

초기) Modality 별 Expert 자체 성능 향상에 집중 (Li, specialisation loss에 집중)

후기) Expert 출력값의 collaboration, gating collaboration에 집중 (Lmome 강조)

- Experiments

1) Dataset: 9개의 Brain lesion dataset (6,585개의 3D 영상), T1,T1c,T2,FLAIR,DWI /

Brain Tumor, WMH(백질 고강도 병변), ISL(뇌경색), MS(다발성경화증), TBI(외상성),

CMBs(미세출혈), Glioma subregions, 기타

2) Baselines: Task-specific model(U-Net, nnU-Net, Attention U-Net) / Multi-task/foundation model(SAM-MED3D, Hermes, MultiTalent)

3) Evaluation metrics: DSC, Hausdorff Distance, Sensivity

4) Results:

| nnU-Net (task-specific) | 0.85 | 0.70 | 높은 정확도 but generalization 낮음 |

| SAM-Med3D | 0.80 | 0.72 | 기존 범용 모델 |

| MoME (Ours) | 0.86 (+1 ~ +3%) | 0.77 (+5 ~ +7%) | 가장 높은 일반화 성능 |

- Conclusion

MoME는 multipe modalities를 처리하는 Expert module, hierarchical gating, curriculum learning을 결합해 Brain Segmentation 모델을 구축하였음.

하나의 모델로 여러 병변과 모달리티를 처리할 수 있어 효율성이 뛰어나지만 missing modality 상황에서나 복잡한 모델 구조에서는 부담 존재함.

'Paper_Review' 카테고리의 다른 글

| [jekim] Paper review (1) | 2025.11.08 |

|---|---|

| [jyhan] paper review (0) | 2025.11.08 |

| [jyhan] paper review (0) | 2025.11.01 |

| [jekim] Paper review (2) | 2025.10.20 |

| [jslim] paper review (0) | 2025.09.28 |